Am schöpferischen NullpunktIm Interview: Stefan Goldmann hat ein Buch über Presets in der elektronischen Musik geschrieben

13.8.2015 • Sounds – Interview: Malte Kobel

Grafik: Grauer Synthesizer via Shutterstock

Presets, vorgefertigte Klänge, mit denen Synthesizer oder Plug-Ins bestückt sind, haben einen schlechten Ruf. Verwendet werden sie dennoch von allen. Gerne auch mal ausschließlich. Das ist dann zwar noch uncooler, spart aber Zeit. Time ist eben money. Presets gibt es, seit Synthesizer Speicher-Chips haben, auf denen sich Klänge und Einstellungen ablegen lassen. Einige Presets sind so markant und wurden so oft verwendet, dass sie untrennbar mit einem Song oder sogar mit einer ganzen Epoche verbunden sind. Stefan Goldmann, bekannt als DJ, Produzent und Macher des Berliner Labels Macro, hat sich dem Phänomen Preset gleich auf zwei Wegen genähert: Auf seinem Album „Industry“ macht er sich als musikalischer Schöpfer weitgehend davon, lässt die Synthies selbst für sich sprechen. In seinem zeitgleich veröffentlichten Buch kommen zahlreiche Musiker, Produzenten und Entwickler zum Thema Presets zu Wort: klassische Pianisten, Sound-Entwickler, Heavy-Metal-Producer. Denn Presets sind überall. Malte Kobel hat Stefan Goldmann getroffen.

Hallo Stefan, reden wir über Presets. Du hast dich ja mit dem Thema nicht nur in deinem Interview-Buch beschäftigt, sondern deine Entdeckungen auch musikalisch auf Platte umgesetzt. Was fasziniert dich an Presets?

Das Thema begleitet mich, seit ich elektronische Musik mache. Die Verwendung von Presets – oder auch die Verweigerung – scheint ein unreflektiertes Kriterium zu sein, um bestimmte Musik abzuwerten. Man kennt das aus den letzten Jahren: die Witze über David Guetta, Avicii oder andere Kommerzgrößen - der benutzt dieses oder jenes Preset. Und damit soll die Musik dann schon entwertet sein. Die Frage ist: wieso eigentlich?

Auf der anderen Seite soll etwas, was besonders viel Programmieraufwand erfordert, auch automatisch kulturell sehr wertvoll sein: komplexe Max-MSP-Patches, krasse FFT-Verschachtelungen, Granularsynthese. Da ist irgendwann ein eigener elektronischer Handwerksbegriff entstanden, der in seiner Einfalt nicht anders ausfällt als die Virtuosenkultur der herkömmlich erzeugten Musik. Aphex Twins Glitch-Orgien sind dann so etwas wie die fünf Oktaven Stimmumfang von Mariah Carey. Joe Satriani spielt mehr Töne pro Sekunde als Jimmy Page, also ist er der bessere Gitarrist. Da kann man gut ansetzen und diese Debatte entsprechend vorführen. Üblicherweise macht es viel mehr Spaß, solche Dogmen und Ansprüche zu unterlaufen, als sie aufrecht zu erhalten. Deshalb ist das ein so dankbares Thema.

Und es ist interessant zu sehen, wie weit diese Automatisierung eigentlich schon fortgeschritten ist. Niemand bleibt davon verschont, riesige Gebiete sind komplett abhängig: Filmmusik und EDM zum Beispiel. Damit war der Zeitpunkt für eine gründliche Bestandsaufnahme gekommen.

Im Buch fällt schnell auf, dass du den Begriff Preset nicht nur für die technische Voreinstellung bestimmter Parameter eines Synthesizers oder für Plug-Ins einer Digital Audio Workstation benutzt, sondern weitergehend versuchst, generelle, kulturelle Presets aufzuspüren. Wie definierst du Presets? Hat sich der Begriff für dich im Laufe der Arbeit verschoben?

Die erwähnte Vergötterung von Aufwand im Sounddesign geht meiner Beobachtung nach auffällig einher mit einer Verminderung von Aufwand an anderer Stelle, vor allem auf struktureller Ebene. Daran ist nichts verwerflich, nur herrscht meist überhaupt kein Bewusstsein dafür, dass die Konzentration auf einen Bereich mit weniger Aufmerksamkeit an einer anderen Stelle bezahlt werden muss. Krasses Sounddesign funktioniert am besten in sehr konventionellen Strukturen. Es gibt schlicht keine umfassend komplexe Musik. Entsprechend haben Presets auch zur Folge, dass Aufmerksamkeit umgelenkt wird: Wenn ich kein Sounddesign mehr betreiben muss, weil die Presets ohnehin schon ausreichend sind, kann ich mich an etwas anderem abarbeiten. Ein Preset ist daher eine Entscheidung, die mir jemand abnimmt, die kulturell vorgeformt ist. Ob sich das auf Sounddesign bezieht oder auf die Entscheidung, im Viervierteltakt in einem quantisierten Raster zu arbeiten, in den üblichen chromatischen zwölf Tönen, mit bestimmten Instrumenten usw. – das sind letztlich gleichwertige Festlegungen.

Die Frage ist also nicht, ob Vorgefertigtes verarbeitet wird, sondern nur an welcher Stelle und wie. Neu ist, dass Dinge in Presets überführt werden können, die früher zwangsläufig individuell geformt werden mussten. Damit rückt alles auf die gleiche Ebene.

Von welchen Bereichen sprichst du hier? Betrifft das auch schon Bereiche wie Songwriting oder Mastering?

Wir sind an einem historischen Punkt, an dem für fast jede musikalische Handlung ein Produkt zur Automatisierung angeboten wird. Das geht los beim Generieren von Melodien, ihrer Harmonisierung, Begleitautomatiken aller Art, Emulationen historischer Klangerzeuger und Effekte bis hin zu komplett automatisierten Mix- und Mastering-Lösungen. Qualitativ ist das oftmals ein Witz, aber das ist nur eine Momentaufnahme. Die Entwicklung geht rasend schnell. Letztlich kann alles, was zuverlässig wiedererkannt wird, irgendwann auch in ein Preset geschrieben werden.

Im Buch habe ich versucht, diese Bandbreite darzustellen, über Interviews mit Protagonisten aus traditionellen Musiken, Klassik, Heavy Metal. Es gibt wirklich Menschen, die komplette „akustische“ Einspielungen am Rechner zusammensetzen, Gitarrenverstärker-Signale mitsamt den dazugehörigen Effektpedalen und Mikrofonen in Algorithmen falten oder meinen, ein Digitalklavier biete in bestimmten Situationen enorme Vorteile gegenüber einem Konzertflügel. Das ist alles schon Praxis, keine Utopie mehr.

Dein neues Album „Industry“ reflektiert diese Überlegungen in musikalischer Weise. Wie bist du hier vorgegangen? Was hast du noch selber musikalisch gearbeitet und was komplett an Automatismen abgegeben? Es heißt ja so schön dort: 0% Sounddesign, 100% Presets.

Zunächst wollte ich sehen, ob ich mich aus dem schöpferischen Prozess komplett herausziehen kann. Was bleibt dann eigentlich übrig? Andererseits wollte ich kein Preset-Demo des aktuellen Software-Angebots hervorbringen. Ich habe mich daher auf „obsolete“ Instrumente besonnen, auf Synthesizer, Workstations aus den 1990er-Jahren, die nicht sonderlich populär sind und das auch nie waren.

Diese Geräte sind voll von Presets, die in der Hoffnung programmiert wurden, den Zahn ihrer Zeit zu treffen. Doch die Zeit klang ganz anders.

Dadurch kann man eine Archäologie dieser Parallelwelten betreiben, die sich nie realisiert haben. Ich habe auf Ebay die drei erstbesten Workstations gekauft, die es gab und die mir nichts sagten - alle zwischen 100 und 300 Euro. Das sind Geräte, die neu das Zwanzigfache gekostet haben. Allein ob des Preisverfalls konnte ich relativ sicher sein, dass niemand mit diesen Klängen irgendetwas verbindet.

Um nicht neu zu komponieren, habe ich MIDI-Files alter Stücke von mir geplündert und den Synths zugewiesen. Also kein Arrangement-Aufwand im herkömmlichen Sinne. Nur Mischen musste ich noch selbst, MixGenius war noch nicht auf dem Markt. Letztlich habe ich nur Lautstärkeverhältnisse eingestellt. Ich habe schnell gemerkt, dass die einzelnen Presets schon werksseitig so programmiert sind, dass sie sich nicht gegenseitig behindern. Man muss also gar nicht groß etwas im Stereopanorama zurechtrücken. Shuffles, Effekte - alles Presets. Man steht also wirklich vor einem schöpferischen Nichts, gewissermaßen am Nullpunkt. Gemastert wurde es dann immerhin regulär. Da es jetzt mit Landr vollautomatisches Mastering gibt, überlege ich, noch mal eine zweite Version zu veröffentlichen, um A/B-Vergleiche möglich zu machen und noch diese subjektive Ebene des Masterings zu eliminieren.

##Wo bleibt der Mensch?

Ist nicht das eigentlich der lang gehegte Traum von der vollautomatisierten Maschinenmusik? Der Mensch wird nun wirklich nicht mehr gebraucht.

Nicht ganz, weil es sich immer um von Menschen geformtes Material handelt. Im doppelten Sinn: Presets sind meist darauf ausgerichtet, Bekanntes zu replizieren, also Klänge, die gerade aufgrund ihrer Individualität auffallen. Die Übersetzung in ein Set von Einstellungen ist dann noch eine weitere Interpretation. Und das ist ein zentrales Problem von Algorithmen, die beispielsweise harmonisieren oder Drumpatterns generieren sollen: Ein Programmierer muss entscheiden, was wann wo passt oder nicht. Es bleibt also Menschenwerk und ist nie neutral.

In den Interviews, die ich mit dem Entwicklerteam des Korg M1 - einem der meistverkauften Synthesizer aller Zeiten - geführt habe, wurde mir klar: Da gab es ganze Komitees, die diese Klänge ausgewählt und bewertet hatten. Dadurch gibt es keinen direkt Verantwortlichen mehr. Es ist ein bisschen wie in diesem Spruch aus einer Simpsons-Serie: Kaufhausdiebstahl ist wie jemanden im Dunklen schlagen - ein Verbrechen ohne Opfer. Der Gesamtvorrat an verfügbaren Presets funktioniert irgendwann so wie der Duden: Kompressor auf Frauenstimme geht so, funky Gitarrenlick so. Eine normierte Grammatik und Orthografie von Klang. Die Normen entstammen aber nicht einer eigenständigen Maschinenlogik, sondern sind eine Kollektivleistung, die von einer Redaktion kodifiziert wird. Der Künstler macht dann natürlich immer etwas, was in der Grammatik so nicht vorgesehen ist. Dafür wird er gebraucht.

##So klingt der Korg M1

Werden nicht trotzdem diejenigen Personen, die zum Beispiel im Falle vom Korg M1 gerade für ganze Genres und Epochen einen Sound komponiert haben, oft vergessen? Sie bekommen keine Credits und gehen auch nicht als Autoren in die Geschichtsbücher ein.

Ich bin mir gar nicht sicher, ob diese Anerkennung wirklich jeder will. Mike Daliot zum Beispiel hat ja im Buch zum ersten Mal überhaupt ein Interview gegeben. (Entwickler und Sounddesigner bei Native Instruments, verantwortlich u.a. für die Software Massive, die vor allem in EDM-Kreisen Verwendung findet, d. Red.) Auktoriale Presets sind ein Phänomen der letzten zehn Jahre. Davor ging es eigentlich oft darum, vorhandene Klangideen umzusetzen, etwa das berühmte Klavier des Korg M1. Dass so ein Klang plötzlich sehr prägend wird, ist keine Leistung der Entwickler sondern dem Abstand geschuldet zwischen dem, was sie eigentlich erreichen wollten und dem, was sie erreichen konnten. Dass diese Fehlleistungen positiv umgedeutet werden konnten, dafür gab es praktisch nie ein Bewusstsein. Das gleiche gilt für die Roland-Maschinen TB-303, TR-808 und TR-909. Die haben ja mit 30 Jahren Verzögerung begriffen, was sie überhaupt geleistet haben. Es gibt keine Person, die sich da etwas auf die Fahnen schreiben könnte. Der Stolz sitzt wohl eher im ingenieursseitigen Erreichen eines Kostenziels: Es waren ja riesige Hürden zu nehmen, bis zum Beispiel ein Yamaha DX7 erschwinglich hergestellt werden konnte. Dass solche Instrumente kulturell so weit reichen, hat nie jemand voraussehen können.

Auf deinem Album sind alle benutzten Synthies und Sounds als „Mitwirkende“ aufgelistet. Wo hört die Arbeit des Entwicklers auf, wo fängt die des Künstlers an? Viele der Protagonisten, die du interviewst, sind ja notgedrungen oft beides.

Mir ist mal etwas aufgefallen in einer Doku, die Avicii bei der Arbeit zeigt. Er klickt sich mit einer fertigen Melodie durch Listen von Presets, bis eines passt. Da wird nichts eingestellt. Mir ging da ein Licht auf: Wie schwierig es ist, als Außenstehender die psychologische Investition nachzuvollziehen, die in einer solchen Arbeit steckt. Außenstehenden bleibt diese subjektive Bedeutung der Arbeit am Klang oft verborgen.

Es gibt Hunderte von Leuten, die Musik mit Modularsynthesizern machen, aber es gibt kaum bedeutende Platten, die damit entstehen.

Der Grund dafür könnte in diesem Abstand zwischen Erzeuger und Hörer liegen: Der Erzeuger hört Sound quasi als Symbol des eigenen Aufwands, der Hörer nicht. Anscheinend kann dieser Abstand so groß werden, dass die Verbindung reißt, die nötig wäre, damit beide Seiten sich noch kommunikativ begegnen können. Der Modus Avicii reduziert diesen Abstand auf Null. Wenn er einen Sound auswählt, tut er das im gleichen Zeitfenster, in dem irgendwer in den Arenen, in denen er auftritt, diesem Sound begegnet. Da wird also nichts verwendet, was nicht in Sekundenbruchteilen überzeugt. Diese Massenwirkung ist mit avanciertem Gefrickel also nie und nimmer zu erreichen und somit stellt sich eine Arbeitsteilung ein zwischen Programmierern, die sich in Untiefen verlieren und irgendwann mit einem Sound wieder auftauchen und „Kuratoren“, die unvoreingenommen diese Sounds auf ihr kommunikatives Potential hin abklopfen.

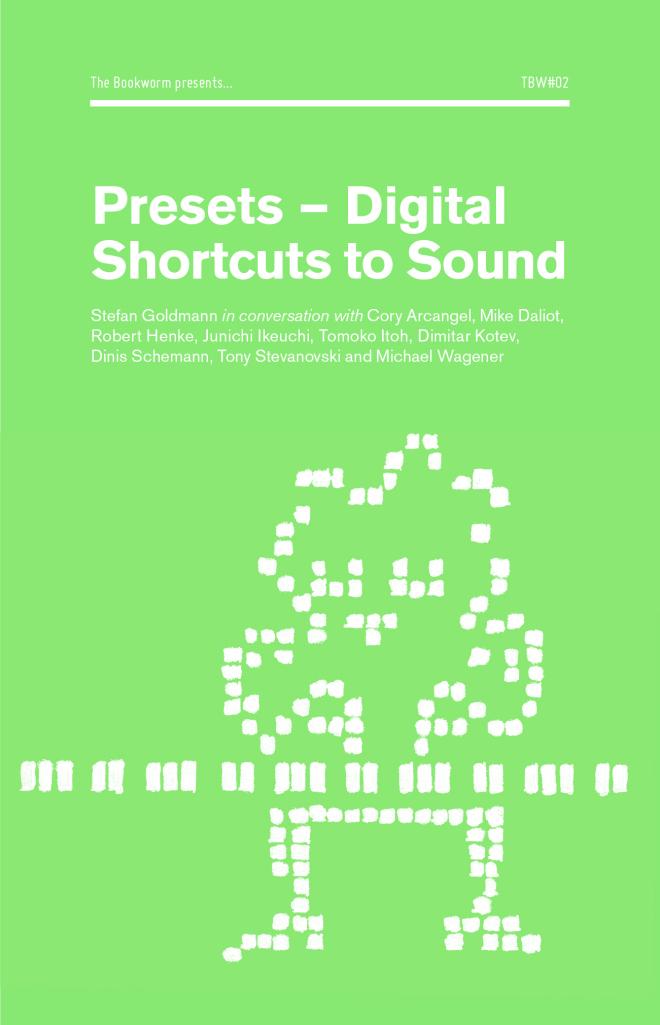

Stefan Goldman, Presets – Digital Shortcuts to Sound, ist bei The Bookworm erschienen und kann hier bestellt werden.

Schaut man sich die Musiktechnologie der letzten 150 Jahre an, kann man wohl immer auch eine Wechselbeziehung zwischen Musik, Technik und der Wahrnehmung von Klängen erkennen. Was glaubst du, wie die Omnipräsenz von Presets unsere Ohren und Wahrnehmung tangiert hat und noch tangieren wird?

Man gewöhnt sich an eine Kompressionskennlinie eines „Urei 1176“ genau so wie man sich früher an Klangeigenschaften eines Klaviers gewöhnt hatte. Gestalten, Muster, Kategorien der Wahrnehmung haben sich als extrem dynamisch, wandelbar, immer wieder neu und anders erlernbar erwiesen. Presets spiegeln vermutlich schon in ihren quantitativen Verteilungen kulturelle Gewichtungen. Das ist eigentlich der Datensatz, der die Musikwissenschaft die nächsten 30 Jahre beschäftigen müsste. Wenn man an der Musik zwischen 1960 und heute - also einer Musik, die sich vor allem in Auseinandersetzung mit dem Aufnahmemedium entfaltet hat - noch etwas verstehen möchte, kommt man eigentlich nur noch mit kognitiver Psychologie und quantitativen Methoden weiter. Dass der Klangvorrat dieser Zeitspanne gewissermaßen eingefroren wird, normiert wird auf ikonische Klänge bestimmter Epochen, überführt uns aus einer Zeit rasanter ästhetischer Innovation in eine klassizistische Phase. Wenn man das linear fortdenkt, würde es gewissermaßen nur noch darum gehen, wer am besten Led Zeppelin oder Adonis oder Autechre imitiert. Der reinste Akademismus. Wenn einem diese ganzen Klänge irgendwann so gründlich aus den Ohren heraushängen, dass man sie nicht mehr erträgt, dann werten sie sich vielleicht auch wieder so weit ab, dass an ihre Stelle etwas anderes tritt. Es bleibt ja nie alles so, wie es gerade ist.