Warum KI das nächste große Ding istUnderstanding Digital Capitalism III | Teil 8

12.3.2018 • Gesellschaft – Text: Timo Daum, Illustration: Susann Massute

Auch wenn digitale Assistenten noch längst nicht das können, was ihre Erfinder versprechen: Die Popularität von Alexa und Co. ist leicht nachvollziehbar, wenn man die vergleichsweise neue Technologie in die Historie der Computer-Technik und deren sich stetig weiterentwickelnden Bedienungs-Paradigmen einordnet. Sprachsteuerung verspricht Freiheit – eine Freiheit, die die Nutzer teurer bezahlen müssen als je zuvor. Konrad Zuse dreht sich im Grabe um.

Was bisher geschah

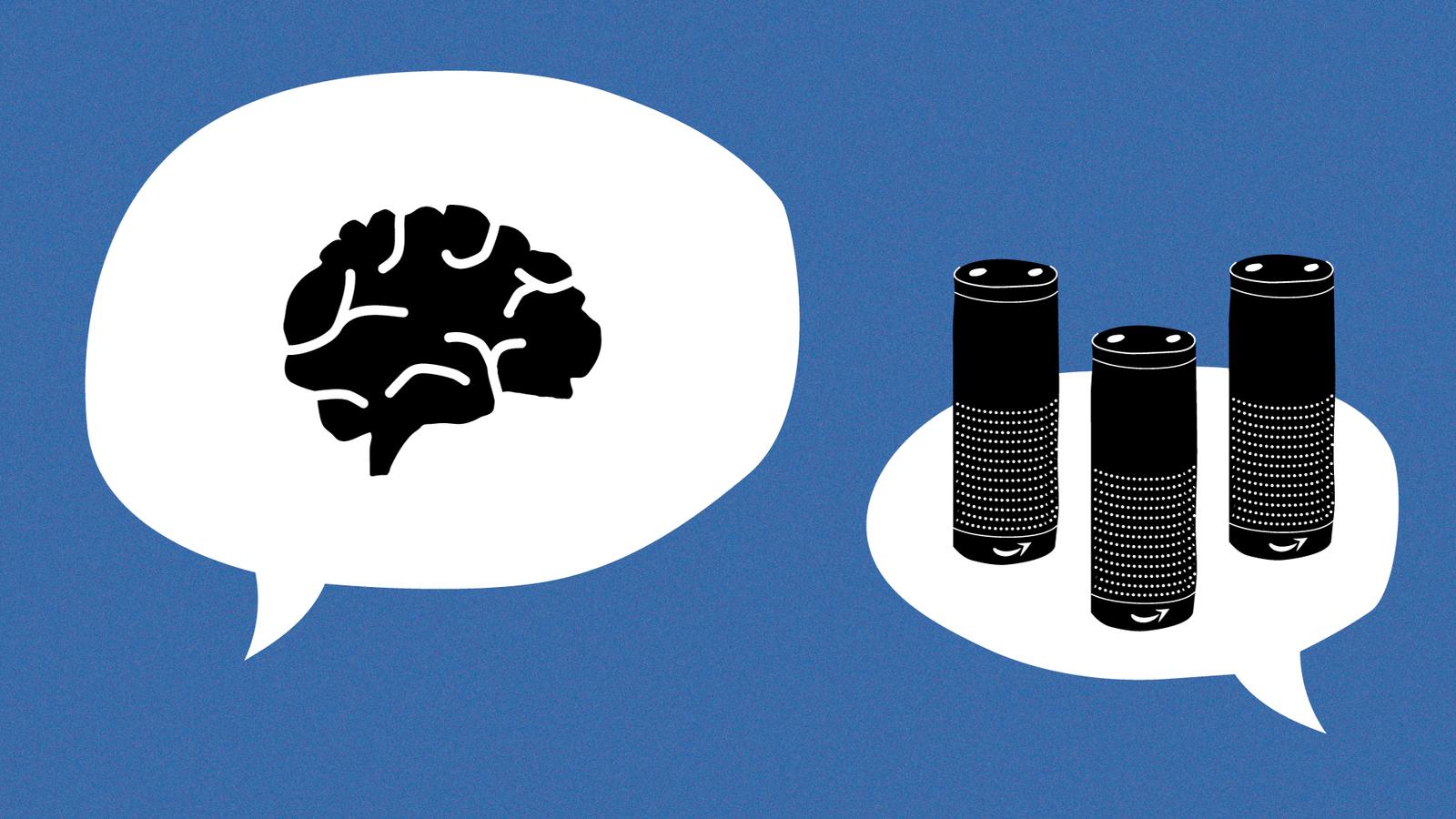

Zuletzt ging es in dieser Reihe um das Bermuda-Dreieck aus KI, Überwachung und der plattformkapitalistischen Verwertung. Die KI der großen Internet-Konzerne verspricht praktischen Mehrwert, fordert aber auch Zugeständnisse. Zwei Unternehmen teilen fast den gesamten Markt unter sich auf: Google und Amazon. Googles digitaler Helfer heißt schlicht Assistant, die Stimme in den Echo-Lautsprechern von Amazon hingegen hört auf den Namen Alexa. Bis 2022 werden allein in den USA 66 Millionen Haushalte ein solches Gerät besitzen, sollten die Analysten von Forrester recht behalten.

„There is no reason anyone would want a computer in their home.“

(Ken Olsen, Gründer der Digital Equipment Corporation, 1977)

Konrad Zuse, Alexa und Patente

Grundlage für diesen Boom sind jüngste Verbesserungen bei den wichtigsten zugrunde liegenden Technologien: Spracherkennung und Sprachgenerierung sowie die Analyse natürlicher Sprache mittels Deep Learning. Im Zusammenspiel dieser drei Techniken wollen deren Herren das Traumziel erreichen: dem User den möglichst perfekten Eindruck zu vermitteln, er könne sich mit den Assistentinnen ganz normal unterhalten. Und für die beteiligten Unternehmen springt auch was dabei heraus.

Der Berliner Konrad Zuse gilt als Erfinder des modernen Computers. Bereits 1938 hatte er im elterlichen Wohnzimmer den ersten – noch mechanischen – programmierbaren Rechenautomaten aus Alublechen gebastelt. Es war zugleich der erste Rechner, der intern im Dualsystem operierte. Drei Jahre später erblickte dann der erste vollautomatische, in binärer Gleitkommarechnung arbeitende Computer mit einer Zentralrecheneinheit aus Telefonrelais das Licht der Welt: der Zuse Z3. Noch im selben Jahr versuchte Konrad Zuse seine Erfindung patentieren zu lassen. Erst sieben Jahre nach Kriegsende wurde ihm das Patent schließlich zuerkannt, jedoch sogleich von anderen Herstellern angefochten. Im Jahr 1967 konstatierte das Bundespatentamt letztinstanzlich, dass kein Patent ergehen könne. Die Begründung: „mangelnde Gestaltungstiefe“. Zuse hatte versucht, das konkrete Design des Z3 patentieren zu lassen, anstatt grundlegende konzeptionelle Elemente seiner Erfindung, etwa die Prozesssteuerung mit Programm- und Datenspeicher. Wie die Computergeschichte wohl ausgegangen wäre, wenn Zuse sein Patent erhalten hätte und in Folge dessen alle Computerfirmen der Welt Lizenzgebühren an ihn hätten abführen müssen?

70 Jahre später hatten vier Ingenieure mit ihrem Patentantrag mehr Glück. Wenige Sätze und eine Skizze genügten, um das Funktionsprinzip ihrer Idee zu beschreiben. Ein männlicher Benutzer in einem ruhigen Raum sagt: „Bitte spielen Sie ‘Let It Be’ von den Beatles.“ Ein kleines Desktop-Device antwortet: „Kein Problem, John“ und beginnt mit dem Abspielen des gewünschten Songs. Am 31. August 2012 hielten die vier schließlich ein Patent für ein System Künstlicher Intelligenz in den Händen, das mit natürlicher Sprache zu kommunizieren in der Lage sein sollte. Der Arbeitgeber der vier hieß Amazon. Das Produkt, das aus diesem Patent letztlich entstehen sollte, hört auf den Namen Alexa.

Revolutionäre Produkte bedeuten auch revolutionäre Interfaces

Digitale Sprachassistenten schlagen ein neues Kapitel in der Geschichte des User Interface auf. Nicht nur im Home-Bereich, auch im autonomen Auto der Zukunft, für die Interaktion mit Geräten in allen Lebenslagen (Internet of Things), der Industrie, Logistik und Transport wird natürliche Sprache bei der Bedienung an Bedeutung gewinnen. „Until now, all of us have bent to accommodate tech, in terms of typing, tapping, or swiping. Now the new user interfaces are bending to us“, sagt Ahmed Bouzid, Chef von Witlingo, einer Firma, die auf sprachgesteuerte Apps spezialisiert ist. Die Computergeschichte ist auch eine Geschichte genau dieser Nutzer-Schnittstellen: Lochkarten, Tastatur, Maus, Multi-Touch – jedes dieser Interfaces ist eng verknüpft mit einer bestimmten Phase der Computer-Nutzung. Neue User Interfaces ermöglichen auch andere Nutzungsweisen, Anwendungen und Geschäftsmodelle.

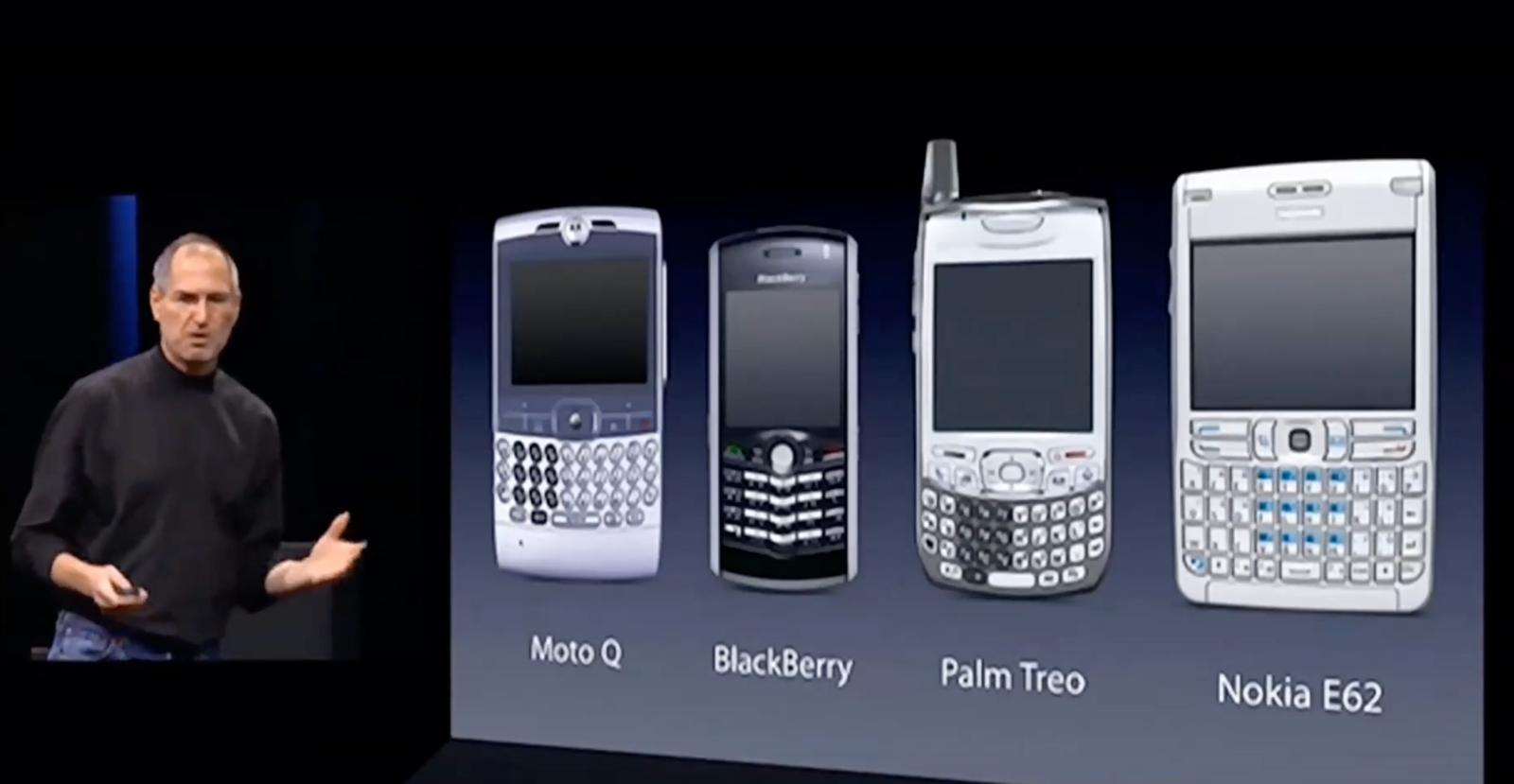

Am 9. Januar 2007: Steve Jobs präsentiert das erste iPhone

Steve Jobs hatte das klar erkannt und formulierte auf der Weltpremiere des ersten iPhones folgendermaßen: „Every once in a while, a revolutionary product comes along that changes everything. The mouse, the click-wheel, multitouch. Each of these revolutionary interfaces has made possible a revolutionary product.”

Zehn Jahre iPhone – mehr zum Thema

Lochkarten als umständliche und langsame Datenträger waren zu Zeiten der Großrechner bis in die 1960er-Jahre üblich. Die Programmierung war mühsam, und die Anschaffung der Geräte lohnte sich nur für Spezialaufgaben in Großunternehmen, in der Wissenschaft oder beim Militär. Mit dem Aufkommen von Tastatur und Bildschirm an Computerterminals, die an Zentralrechner angeschlossen waren, begann auch die nächste Phase der Computernutzung: Immer mehr Unternehmen konnten sich die sogenannten Mikro-Computer leisten, sie waren aus vielen Abteilungen nicht mehr wegzudenken – mussten aber auch immer noch von geschultem Personal bedient werden und waren weitgehend voneinander isoliert. Die Erfindung der Maus durch Douglas C. Engelbart 1963 und die Entwicklung der ersten grafischen Benutzeroberfläche (GUI) im Xerox Forschungslabor 1973 in Palo Alto markieren den Start für die PC-Revolution. Erst durch die zweidimensionale Simulation einer Schreibtischoberfläche („Desktop“) wurden Computer in ihrer Bedienung so einfach, dass sie für den Privatnutzer interessant wurden.

Auch bei Apples Disruption der Musikindustrie – mit dem iTunes Store – war ein bahnbrechendes User-Interface im Spiel: das Klick-Rad des Musikabspielgeräts iPod. Als Apple schließlich das iPhone vorstellte, war wiederum ein neues User-Interface entscheidend für dessen Durchbruch: ein großer Bildschirm, der mit den Fingern bedient werden konnte, ersetzte radikal die Kombination aus proprietären Plastiktastaturen bei den von Jobs despektierlich „so-called smart phones“ genannten Geräten, wie dem Nokia E62.

Steve Jobs disst die Smartphones, die es 2007 zu kaufen gab.

Warum KI das nächste große Ding ist

Natürliche Sprache als bidirektionaler Kommunikationskanal mit einem Device ist das Interface der nächsten Welle. Im Zuge dieser Entwicklung wird das Smartphone als wichtigstes digitales Device möglicherweise seine Dominanz einbüßen. Die Analysten von comScore haben errechnet, dass im Jahr 2020 bereits jede zweite Suchanfrage als Spracheingabe erfolgen wird.

Amazon ist weniger Online-Händler als Datenplattform – das Geschäftsmodell ist dem von Google und Facebook ähnlicher, als dem von Walmart oder Otto.

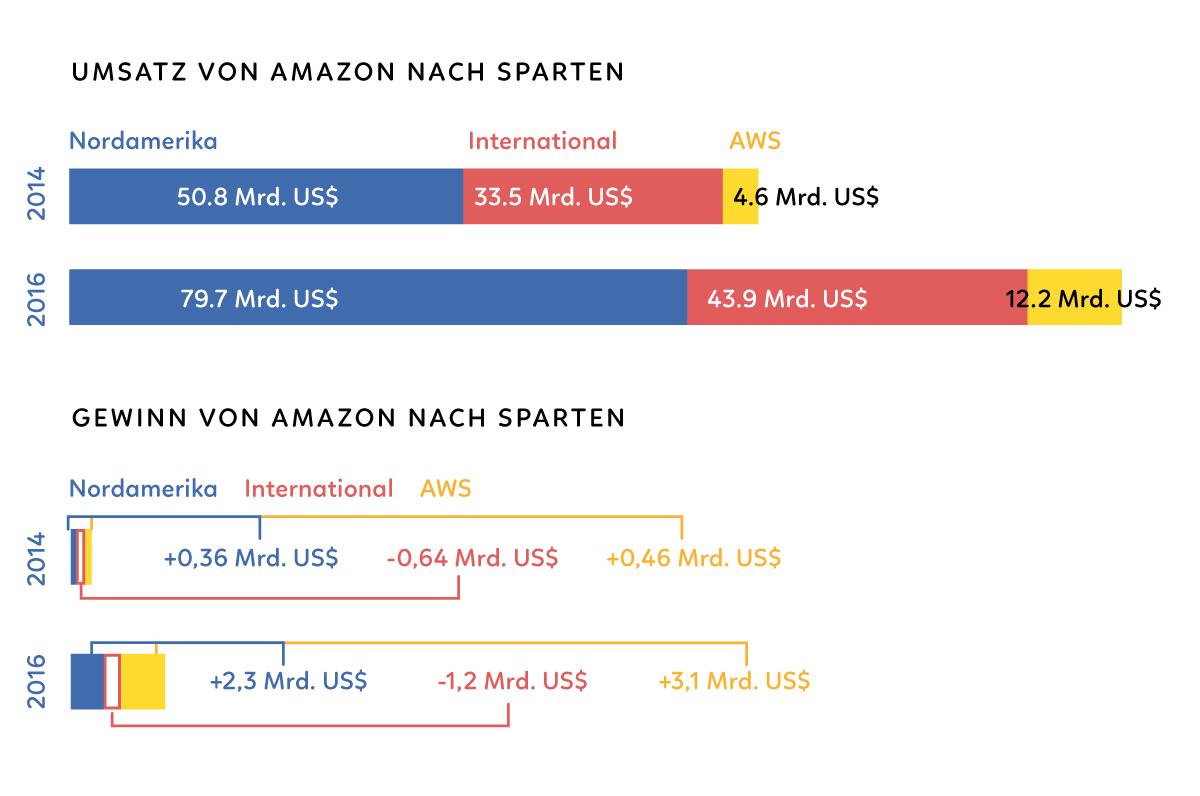

Wie kam es eigentlich dazu, dass Amazon auf den KI-Zug aufgesprungen ist? Angefangen hat Jeff Bezos' Firma 1994 als Online-Händler für Bücher – und ist inzwischen zu einem der größten Einzelhändler weltweit geworden. Aber Amazon ist mehr als das. Das Unternehmen gibt viel Geld für Forschung und Entwicklung aus und ist ständig auf der Suche nach neuen Geschäftsmodellen. Bereits 2006 ging Amazon Web Services (AWS) als Tochterunternehmen an den Start. Es stellt On-Demand-Cloud-Computing-Plattformen für Einzelpersonen, Unternehmen und Regierungen auf kostenpflichtiger Basis bereit. AWS ist der am stärksten expandierende Teil von Amazon, dabei allerdings für gerade einmal neun Prozent des Umsatzes verantwortlich. Beim Gewinn sieht die Sache völlig anders aus: 74 Prozent von Amazons Gewinn entfallen auf AWS. Das ist mit ein Grund, warum Amazon – entgegen der landläufigen Meinung, es sei ein Online-Händler – eher eine Datenplattform ist, dessen Geschäftsmodell dem von Google und Facebook ähnlicher ist als dem von Walmart oder Otto. Heute verfügt Amazon über eine der größten Datensammlungen der Welt. Amazons Alexa wäre nicht denkbar ohne die Vorgeschichte von Amazon Web Services.

Anhand dieser Zahlen wird klar, warum Amazon sich in seinen Forschungsbemühungen auf diesen Bereich konzentriert. Marxistisch gesprochen: Hier ist die Profitrate deutlich höher! Nick Srnicek beschreibt die Entstehung plattformkapitalistischer Geschäftsmodelle als Reaktion des Kapitals auf die sinkenden Profitraten in klassischen Branchen. In seinem empfehlenswerten Handbuch zu diesem Thema stellt er fest, „dass sich der Kapitalismus angesichts eines langanhaltenden Rückgangs der Rentabilität in der Produktion von Gütern den Daten zugewandt hat, um zu überleben und weiter expandieren zu können.“

KI ist der logische nächste Schritt nach Big Data.

Alexa – AI First!

Alle großen Datenunternehmen haben sich auf Techniken rund um das machine learning als Königsweg der Auswertung von großen Datensammlungen fokussiert – KI ist der logische nächste Schritt nach Big Data. Im September 2016 wurde eine Allianz großer Internet-Firmen aus der Taufe gehoben, die ihre Forschungsprojekte im Bereich Künstliche Intelligenz bündeln will. Bei der Partnership on Artificial Intelligence sind neben Alphabet (über die Tochterfirma Deep Mind) noch Amazon, Facebook, IBM und Microsoft mit von der Partie. Aber warum ist Amazon in vielen Aspekten an den Konkurrenten vorbeigezogen? Google und Microsoft hatten eigentlich einen Riesenvorsprung, konzentrierten sich aber auf das Smartphone bzw. den PC als Device für ihre Sprach-KI. Amazons Alexa hingegen ist das erste AI-first device und keine Erweiterung für bestehende Geräte. Der Durchbruch kommt anscheinend mit der von Grund auf neu konzipierten Palette aus Hardware, Software, Use-cases, Ökosystem und Business-Modell – maßgeschneidert für die neue Technologie.

Der Ingenieur Qi Lu, der früher bei Microsoft für Cortana zuständig war und jetzt bei Baidu chief operating officer ist, fasst zusammen: „The Amazon Alexa ecosystem is far ahead of anybody else in the United States. It’s because they got the scenario right. […]it’s actually more about having the right application scenarios and the right ecosystems.”

Damit aus den Echo-Devices ein weltweiter Standard werden kann, wie PCs und Smartphones es geworden sind, ist weit mehr nötig, als Amazon allein jemals wird leisten können. Zu diesem Zweck ermutigt man unabhängige Entwickler, neue Dienste für die Plattform zu entwickeln, so wie es Apple seit langem mit App-Entwicklern getan hat. Mit dem von Amazon zur Verfügung gestellten „Alexa Skills Kit“ (ASK), das Programmier-Schnittstellen (APIs), Tools, Dokumentationen und Codebeispiele enthält, werden Entwickler in die Lage versetzt, innerhalb kurzer Zeit eigene Skills zu erstellen, die Alexas Spracheingabefunktionen integriert. Mittlerweile sind mehr als 25.000 Skills im Amazon Skill Store verfügbar (Stand: Dezember 2017). Alexa bietet Nutzern über Skills – und mit Hilfe von gesprochenen Anweisungen – beispielsweise die Möglichkeit, Musik abzuspielen, Antworten auf allgemeine Fragen zu erhalten, einen Wecker oder Timer zu stellen und mehr. Zu den beliebtesten Apps gehören die Ride-Hailing-Optionen von Uber und Lyft. Um mit Alexa ein Uber bestellen zu können, muss der Nutzer auf seinem Smartphone zunächst die Alexa-App installieren und dort seine Daten hinterlassen. Daraufhin kann das Echo-Device dann mit dem Satz „Alexa, ask Uber for a ride“ ausgelöst werden.

Amazon hat die Echo-Plattform auch für Anbieter von SmartHome-Geräten geöffnet. Für jedes auf dem Markt erhältliche Produkt soll es Skills für Alexa geben. Amazon zielt damit auf die Marktführerschaft in diesem Bereich. Die Produkte aller Firmen, die smarte Lichtsysteme, Stecker und Thermostate herstellen, können mit Skills gesteuert werden, schreibt der Technologie-Experte Mark Sullivan: „Es ist wahrscheinlich, dass die Kontrolle der Sicherheitssysteme für zu Hause auch zu dieser Liste hinzugefügt werden wird.“ Die Alexa-Plattform als Ökosystem für Home-Anwendungen nimmt Gestalt an.

Fazit: An der Schwelle zum Massenmarkt

Die Analysefirma Canalys prognostiziert für 2018 den endgültigen Durchbruch der digitalen Assistenten. Aber auch jenseits davon werden KI-Anwendungen zur Alltagstechnologie. Der IT-Nachrichtenagentur Gartner zufolge werden Technologien maschinellen Lernens bis in zwei Jahren in „fast allen neuen Softwareprodukten“ anzutreffen sein. Das macht aus dem Feld eine Schlüsseltechnologie. Alexa, Siri etc. sind die modernen Sirenen, die wir User einerseits optimieren und gleichzeitig Daten zu unserer immer besseren Vermessung und Voraussage liefern. Plattformkapitalismus mit künstlicher Intelligenz.

Quellen & Links

- Cade Metz, Google is sharing its powerful AI with everyone in its cloud, Wired, 23.03.2017

- Nick Srnicek, Platform Capitalism, Polity Press, 2017

- Mark Sullivan, The Real Reasons That Amazon’s Alexa May Become The Go-To AI For The Home, Fast Company, 31.1.2018

- Dave Elkington, State of Artificial Intelligence 2017 Report, Insidesales.com, 27.3.2017

- Gartner, Gartner Says AI Technologies Will Be in Almost Every New Software Product by 2020, 18.7.2017

- George Anders, Alexa, Understand Me, in: MIT Technology Review, 9.8.2017

Zur Übersicht aller bisherigen Texte der Reihe »Understanding Digital Capitalism«.